이 블로그에서는 PyTorch에서 GPU 활용도를 높일 수 있는 방법에 중점을 둘 것입니다.

PyTorch에서 GPU 활용도를 높이는 방법은 무엇입니까?

GPU 활용도를 높이고 복잡한 기계 학습 모델 처리에 최고의 하드웨어 리소스가 사용되도록 보장하기 위해 사용할 수 있는 몇 가지 기술이 있습니다. 이러한 전술에는 코드 편집과 PyTorch 기능 활용이 포함됩니다. 몇 가지 중요한 팁과 요령은 다음과 같습니다.

데이터 및 배치 크기 로드

“ 데이터 로더 ”는 PyTorch에서 딥러닝 모델의 각 순방향 패스를 통해 프로세서에 로드될 데이터의 사양을 정의하는 데 사용됩니다. 더 큰 “ 배치 크기 ” 데이터가 늘어나면 더 많은 처리 능력이 필요하고 사용 가능한 GPU 활용도가 높아집니다.

PyTorch에서 특정 배치 크기를 가진 Dataloader를 사용자 정의 변수에 할당하는 구문은 다음과 같습니다.

증가_GPU_Utilization = 데이터로더 ( 배치_크기 = 32 )

메모리 의존도가 낮은 모델

각 모델 아키텍처에는 서로 다른 볼륨이 필요합니다. 메모리 '를 최적의 수준으로 수행합니다. 단위 시간당 더 적은 메모리를 효율적으로 사용하는 모델은 다른 모델보다 훨씬 큰 배치 크기로 작업할 수 있습니다.

파이토치 라이트닝

PyTorch에는 다음과 같은 축소 버전이 있습니다. 파이토치 라이트닝 '. 이름에서 알 수 있듯이 매우 빠른 성능에 최적화되어 있습니다. Lightning은 기본적으로 GPU를 사용하며 기계 학습 모델에 대해 훨씬 빠른 처리를 제공합니다. Lightning의 주요 장점은 처리를 방해할 수 있는 상용구 코드에 대한 요구 사항이 없다는 것입니다.

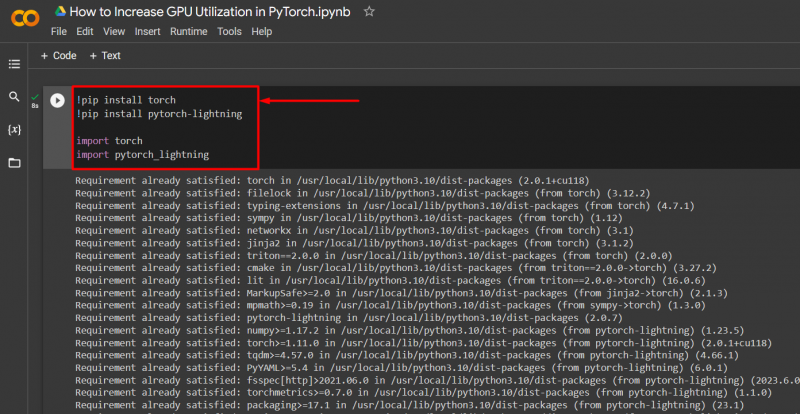

아래 구문을 사용하여 필요한 라이브러리를 PyTorch 프로젝트로 가져옵니다.

! 핍 설치 토치

! pip 설치 파이토치 - 번개

수입 토치

수입 pytorch_lightning

Google Colab에서 런타임 설정 조정

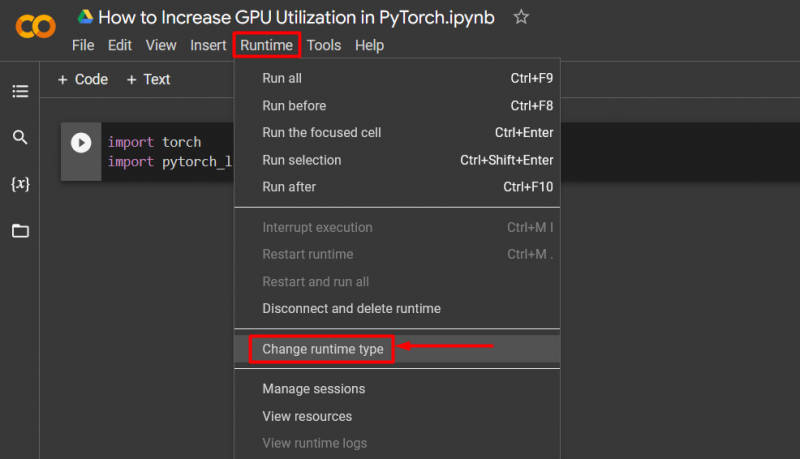

Google Colaboratory는 PyTorch 모델 개발을 위해 사용자에게 무료 GPU 액세스를 제공하는 클라우드 IDE입니다. 기본적으로 Colab 프로젝트는 CPU에서 실행되지만 설정을 변경할 수 있습니다.

Colab 노트북을 열고 ' 실행 시간 메뉴 표시줄에서 ' 옵션을 선택하고 ' 항목이 나올 때까지 아래로 스크롤합니다. 런타임 설정 변경 ':

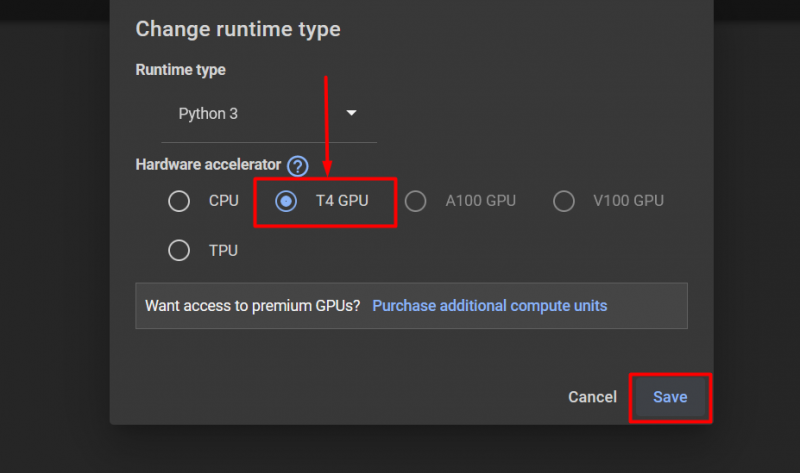

그런 다음 “T4 GPU” 옵션을 선택하고 '를 클릭하세요. 구하다 ' GPU를 활용하기 위해 변경 사항을 적용하려면 다음을 수행하십시오.

최적화를 위해 캐시 지우기

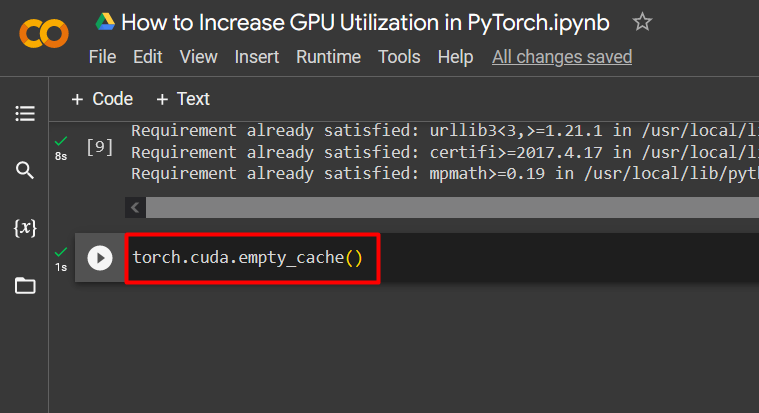

PyTorch를 사용하면 사용자는 새 프로세스를 실행할 수 있는 공간을 확보하기 위해 메모리 캐시를 지울 수 있습니다. “ 은닉처 ”는 실행 중인 모델에 대한 데이터와 정보를 저장하여 해당 모델을 다시 로드하는 데 소요되는 시간을 절약할 수 있습니다. 캐시를 지우면 사용자에게 새 모델을 실행할 수 있는 더 많은 공간이 제공됩니다.

GPU 캐시를 지우는 명령은 다음과 같습니다.

토치. 다른 . 비어있는_캐시 ( )

이 팁은 PyTorch에서 GPU를 사용하여 기계 학습 모델 실행을 최적화하는 데 사용됩니다.

전문가의 팁

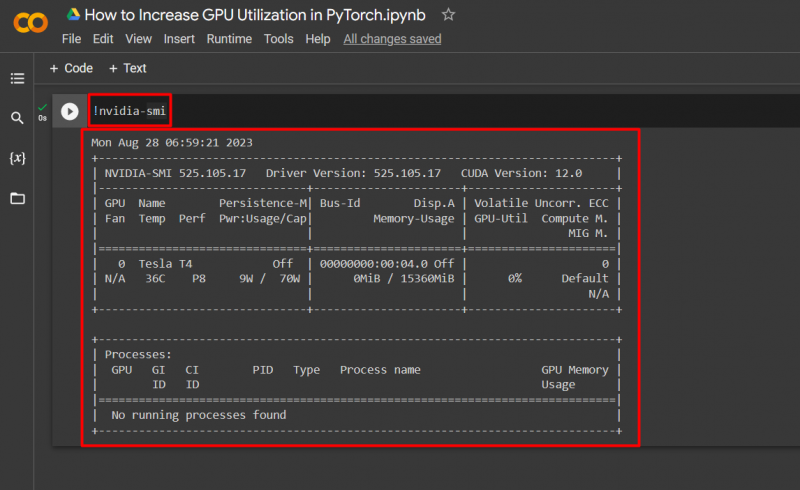

Google Colab을 통해 사용자는 다음을 통해 GPU 활용에 대한 세부정보에 액세스할 수 있습니다. 엔비디아 ”를 통해 하드웨어 리소스가 활용되는 위치에 대한 정보를 얻을 수 있습니다. GPU 활용 세부 정보를 표시하는 명령은 다음과 같습니다.

! 엔비디아 - 미

성공! 우리는 PyTorch에서 GPU 활용도를 높이는 몇 가지 방법을 시연했습니다.

결론

캐시 삭제, PyTorch Lightning 사용, 런타임 설정 조정, 효율적인 모델 사용 및 최적의 배치 크기를 통해 PyTorch의 GPU 활용도를 높입니다. 이러한 기술은 딥 러닝 모델이 최상의 성능을 발휘하고 사용 가능한 데이터에서 유효한 결론과 추론을 도출할 수 있도록 하는 데 큰 도움이 됩니다. 우리는 GPU 활용도를 높이는 기술을 시연했습니다.