ChatGPT의 소프트웨어 개발자는 어떤 위험에 직면합니까?

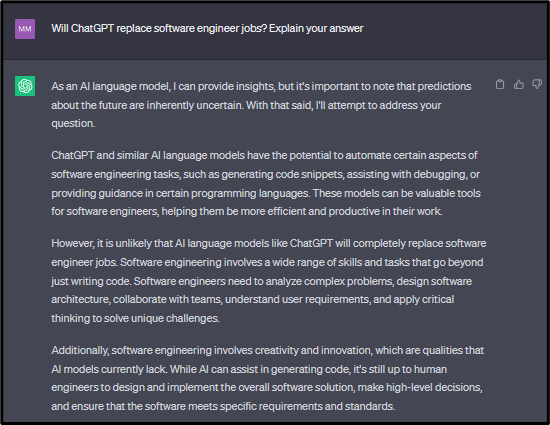

소프트웨어 개발은 기술 세계에서 가장 지루한 작업 중 하나입니다. 처리해야 할 많은 합병증/문제가 있으며 매일 새로운 문제가 발생합니다. 개발자는 치열한 경쟁에서 앞서 나가기 위해 지속적으로 자신의 기술을 발전시키고 작업 흐름을 개선해야 합니다. 게다가 서로 다른 분야나 프로그래밍이 너무 광범위해서 각 프로그래머는 자신만의 전문 분야가 있어야 합니다. 반면 ChatGPT는 일반 프로그래머의 작업에 비해 빠른 시간 내에 광범위한 질문에 대한 답변을 제공할 수 있습니다. 애플리케이션을 통해 확인할 수 있는 복잡한 코드 페이지에 페이지를 신속하게 작성할 수 있습니다.

소프트웨어 개발자가 ChatGPT로부터 안전한 주요 이유

제한된 지식 기반

ChatGPT는 2021년 9월까지 시간이 제한되어 있으며 주어진 날짜 이후에 수행된 새로운 정보나 연구에 액세스할 수 없습니다. 따라서 단순히 인간의 지식과 경쟁할 수 없습니다.

컨텍스트 또는 이해 부족

ChatGPT가 상황의 맥락을 이해하고 환경에 따라 답변을 맞춤화할 수 없다는 것이 큰 단점입니다. 이는 교육 프로그램 내에서 발생하는 모든 문제에 동일한 솔루션을 적용한다는 의미입니다.

창의력 부족

ChatGPT는 새롭고 고유한 솔루션에 적응할 수 없습니다. 최소한의 리소스를 사용하거나 다른 요구 사항을 확인하는 문제에 대한 창의적인 솔루션을 고안할 수 없습니다.

제한된 적응성

그것은 과거의 지식을 활용하고 당면한 상황에 적용할 능력이 없습니다. 물리적 또는 기술적 한계를 고려하면서 솔루션을 고안할 수 없습니다.

윤리적 고려 사항

ChatGPT에서 제공하는 응답은 OpenAI에서 설정한 규정에 의해 관리되지만 조작 텍스트 프롬프트에서 해결 방법을 찾았습니다. ChatGPT의 탈옥 버전은 신뢰할 수 없으며 그 사용은 심각한 윤리적 영향을 미칩니다.

AI와 인간 입력의 통합

현재 상황에서 최선의 방법은 AI와 인간의 입력을 동화하여 다리 작업은 AI가 처리하고 독창성, 창의성 및 문제 해결은 인간에게 맡기는 건강한 시스템을 만드는 것입니다. 이는 개발자가 생산성을 다양하게 높일 수 있는 이해 시스템을 만들 것입니다. ChatGPT가 내린 결정과 작성된 코드는 연구 클라우드에 달려 있습니다.

개별 프로그래머가 직면한 문제가 OpenAI의 TRC(TPU Research Cloud) 내 어디에서도 해결되지 않았을 가능성이 있습니다. 결과적으로 ChatGPT는 어떤 상황에서도 만족스러운 답변을 반환할 수 없습니다. 이러한 종류의 질문은 문제를 해결하기 위해 여러 가지 방법을 브레인스토밍할 수 있는 가장 명석한 사람들의 집합에 의해서만 해결될 수 있습니다. 이것이 개발자 회사가 아직 완전히 AI에 의존하지 않는 근본적인 이유입니다. 반면에 코드 덩어리를 재생산하고 시스템의 버그를 검색하는 것은 프로그래머에게 정신이 아득해지는 작업이 될 수 있습니다. 그러나 이러한 작업은 ChatGPT 및 강력한 프로세서에 대한 우려조차 되지 않습니다. 따라서 미래로 나아가기 위해서는 AI와 인간의 투입이 필수적이라고 말할 수 있습니다.

결론

모든 소프트웨어 개발자는 ChatGPT로 인해 일자리를 잃을 위험이 없습니다. AI를 자신의 이익을 위해 사용할 수 없는 프로그래머는 위험에 처해 있습니다. AI를 제대로 이해하고 이를 사용하여 자신의 작업을 개선할 수 있는 사람은 살아남을 뿐만 아니라 번창할 것입니다. 노력의 융합은 전례 없는 생산성 향상을 가져올 응집력 있는 협업을 창출할 수 있습니다.