LangChain은 텍스트를 생성하고 인간과 상호 작용할 수 있도록 인공 지능을 사용하여 대규모 언어 모델을 구축하는 프레임워크입니다. asyncio는 동일한 명령이나 쿼리를 사용하여 LLM과 같은 모델을 여러 번 호출하는 데 사용할 수 있는 라이브러리입니다. 또한 LLM 모델의 작업 속도를 높여 텍스트를 효율적으로 생성합니다.

이 문서에서는 LangChain에서 'asyncio' 라이브러리를 사용하는 방법을 보여줍니다.

LangChain에서 'asyncio' 라이브러리를 사용/실행하는 방법은 무엇입니까?

Async API는 LLM에 대한 지원으로 사용될 수 있으므로 LangChain에서 asyncio 라이브러리를 사용하려면 다음 가이드를 따르십시오.

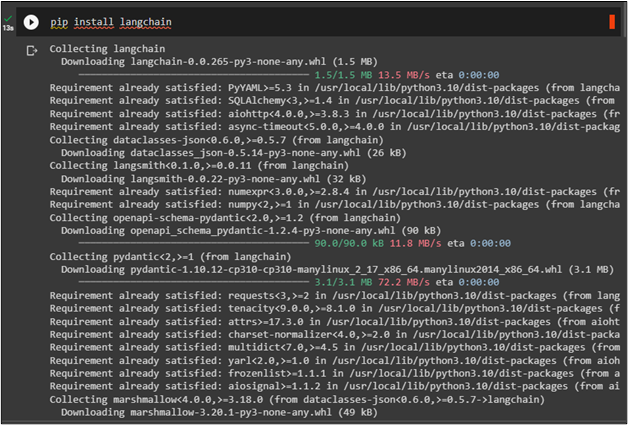

필수 구성 요소 설치

LLM을 동시에 호출하기 위해 LangChain의 asyncio 라이브러리 사용을 시작하려면 LangChain 모듈을 설치하십시오.

씨 설치하다 랭체인

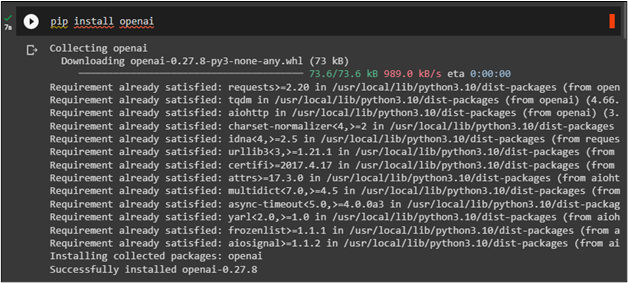

OpenAIembeddings를 사용하여 LLM을 구축하려면 OpenAI 모듈도 필요합니다.

씨 설치하다 개방하다

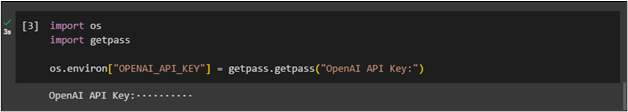

설치 후 다음 코드를 사용하여 OpenAI API 키를 구성하기만 하면 됩니다.

우리를 수입하다가져오기 겟패스

os.environ [ 'OPENAI_API_KEY' ] = getpass.getpass ( 'OpenAI API 키:' )

asyncio를 사용하여 LLM 구축

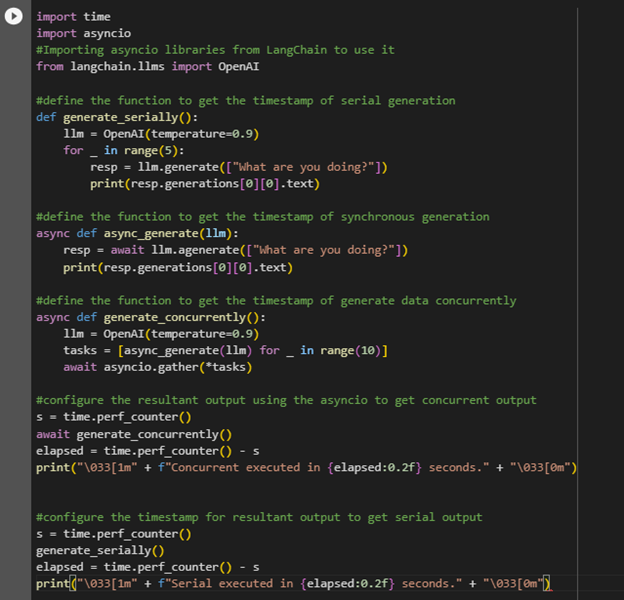

asyncio 라이브러리는 다음 코드가 LangChain에서 사용하므로 LLM을 지원하는 데 사용할 수 있습니다.

수입 시간비동기 가져오기

#LangChain에서 asyncio 라이브러리를 가져와서 사용

langchain.llms에서 OpenAI 가져오기

#직렬 생성의 타임스탬프를 가져오는 함수를 정의합니다.

def generate_serially ( ) :

llm = 오픈AI ( 온도 = 0.9 )

~을 위한 _ ~에 범위 ( 5 ) :

resp = llm.generate ( [ '뭐하세요?' ] )

인쇄 ( resp.세대 [ 0 ] [ 0 ] .텍스트 )

#동기 생성의 타임스탬프를 가져오는 함수를 정의합니다.

비동기 정의 async_generate ( ㅋㅋㅋ ) :

resp = llm.agenerate를 기다립니다. ( [ '뭐하세요?' ] )

인쇄 ( resp.세대 [ 0 ] [ 0 ] .텍스트 )

#동시에 데이터 생성의 타임스탬프를 가져오는 함수를 정의합니다.

비동기 def generate_concurrently ( ) :

llm = 오픈AI ( 온도 = 0.9 )

작업 = [ 비동기_생성 ( ㅋㅋㅋ ) ~을 위한 _ ~에 범위 ( 10 ) ]

asyncio.gather를 기다리세요 ( * 작업 )

#동시 출력을 얻기 위해 asyncio를 사용하여 결과 출력을 구성합니다.

s = time.perf_counter ( )

생성_동시 대기 ( )

경과 = time.perf_counter ( ) - s

인쇄 ( '\033[1분' + 에프 '{경과:0.2f}초 내에 동시 실행되었습니다.' + '\033[0m' )

# 직렬 출력을 얻기 위해 결과 출력의 타임스탬프를 구성합니다.

s = time.perf_counter ( )

generate_serially ( )

경과 = time.perf_counter ( ) - s

인쇄 ( '\033[1분' + 에프 '{elapsed:0.2f}초 후에 직렬이 실행되었습니다.' + '\033[0m' )

위의 코드는 asyncio 라이브러리를 사용하여 다음과 같은 두 가지 고유한 함수를 사용하여 텍스트를 생성하는 시간을 측정합니다. generate_serially() 그리고 generate_concurrently() :

산출

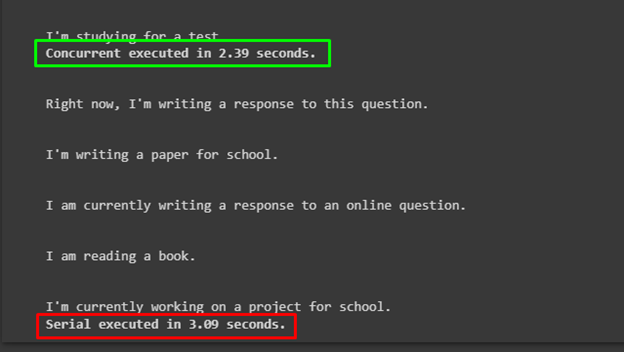

다음 스크린샷은 기능의 시간 복잡도와 동시 텍스트 생성의 시간 복잡도가 직렬 텍스트 생성보다 우수함을 보여줍니다.

LangChain에서 LLM을 구축하기 위해 'asyncio' 라이브러리를 사용하는 것이 전부입니다.

결론

LangChain에서 asyncio 라이브러리를 사용하려면 LangChain 및 OpenAI 모듈을 설치하여 프로세스를 시작하기만 하면 됩니다. Async API는 이전 대화에서 학습할 챗봇을 만들기 위한 LLM 모델을 구축하는 동안 도움이 될 수 있습니다. 이 가이드에서는 LangChain 프레임워크를 사용하여 LLM을 지원하기 위해 asyncio 라이브러리를 사용하는 프로세스를 설명했습니다.