파이프라인() 함수는 Transformer 라이브러리의 필수 부분입니다. 추론 작업, 모델, 토큰화 메커니즘 등을 정의할 수 있는 여러 입력이 필요합니다. 파이프라인() 함수는 주로 하나 또는 여러 텍스트에 대해 NLP 작업을 수행하는 데 사용됩니다. 입력에 대한 전처리와 모델을 기반으로 한 후처리를 수행하여 사람이 읽을 수 있는 출력을 생성하고 최대 정확도로 정확한 예측을 생성합니다.

이 문서에서는 다음 측면을 다룹니다.

포옹 얼굴 데이터 세트 라이브러리란 무엇입니까?

Hugging Face 데이터세트 라이브러리는 여러 공개 데이터세트를 포함하고 이를 쉽게 다운로드할 수 있는 방법을 제공하는 API입니다. 이 라이브러리는 '를 사용하여 응용 프로그램에 가져오고 설치할 수 있습니다. 씨 ' 명령. Hugging Face 라이브러리의 데이터세트를 다운로드하고 설치하는 실제 데모를 보려면 다음을 방문하세요. 구글 Colab 링크. 다음에서 여러 데이터세트를 다운로드할 수 있습니다. 포옹 얼굴 데이터세트 허브.

이 기사를 참조하여 파이프라인() 함수의 기능에 대해 자세히 알아보세요. Transformers에서 Pipeline() 기능을 활용하는 방법은 무엇입니까? '.

Hugging Face의 데이터 세트에 파이프라인을 적용하는 방법은 무엇입니까?

Hugging Face는 한 줄 코드를 사용하여 쉽게 설치할 수 있는 여러 가지 공개 데이터 세트를 제공합니다. 이 문서에서는 이러한 데이터 세트에 파이프라인을 적용하는 실제 데모를 살펴보겠습니다. 데이터세트에 파이프라인을 구현하는 방법에는 두 가지가 있습니다.

방법 1: 반복 방법 사용

파이프라인() 함수는 데이터세트와 모델에 대해서도 반복될 수 있습니다. 이를 위해 아래 언급된 단계를 따르십시오.

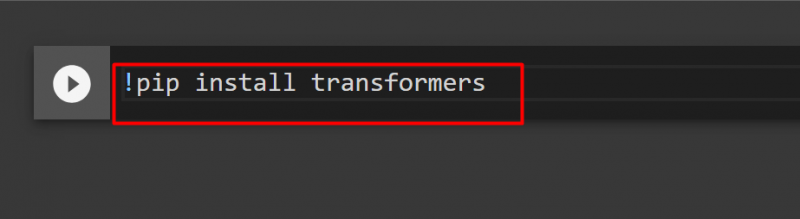

1단계: 변환기 라이브러리 설치

Transformer 라이브러리를 설치하려면 다음 명령을 제공하십시오.

!pip 설치 변환기

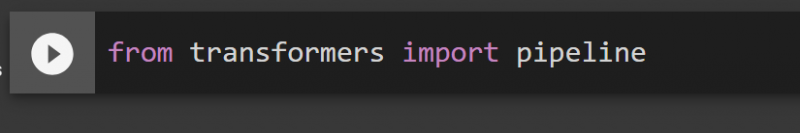

2단계: 파이프라인 가져오기

Transformer 라이브러리에서 파이프라인을 가져올 수 있습니다. 이를 위해 다음 명령을 제공하십시오.

Transformers 가져오기 파이프라인에서

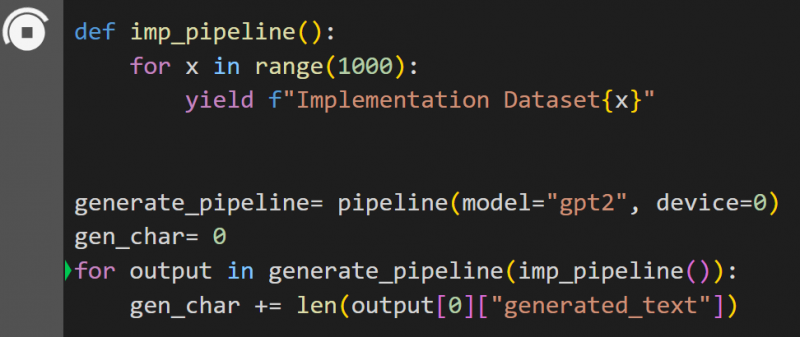

3단계: 파이프라인 구현

여기에서는 파이프라인() 함수가 모델에 구현됩니다. gpt2 '. 다음에서 모델을 다운로드할 수 있습니다. 포옹 얼굴 모델 허브:

def imp_pipeline():범위(1000)의 x에 대해:

f'구현 데이터 세트{x}'를 생성합니다.

generate_pipeline=파이프라인(모델='gpt2', 장치=0)

gen_char= 0

generate_pipeline(imp_pipeline()) 출력의 경우:

gen_char += len(출력[0]['generated_text'])

이 코드에서는 “ generate_pipeline '는 모델 '과 함께 파이프라인() 함수를 포함하는 변수입니다. gpt2 '. '로 호출될 때 imp_파이프라인() ” 기능을 사용하면 1000으로 지정된 범위로 증가하는 데이터를 자동으로 인식합니다.

훈련하는 데 시간이 좀 걸릴 것입니다. 링크는 구글 주식회사 주어지기도 합니다.

방법 2: 데이터 세트 라이브러리 사용

이 방법에서는 '데이터 세트' 라이브러리를 사용하여 파이프라인을 구현하는 방법을 보여줍니다.

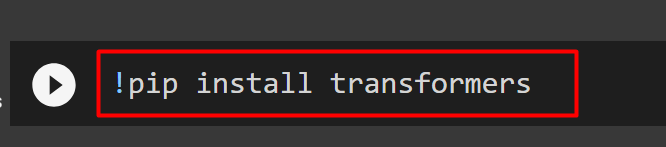

1단계: Transformer 설치

Transformer 라이브러리를 설치하려면 다음 명령을 제공하십시오.

!pip 설치 변환기

2단계: 데이터 세트 라이브러리 설치

“ 데이터 세트 ” 라이브러리에는 모든 공개 데이터 세트가 포함되어 있으므로 다음 명령을 사용하여 설치할 수 있습니다. '를 설치함으로써 데이터세트 ” 라이브러리에서는 이름을 제공하여 모든 데이터 세트를 직접 가져올 수 있습니다.

!pip 설치 데이터세트

3단계: 데이터세트 파이프라인

데이터세트에 파이프라인을 구축하려면 다음 코드를 사용하세요. KeyDataset은 사용자가 관심을 갖는 값만 출력하는 기능입니다.

Transformers.pipelines.pt_utils에서 KeyDataset 가져오기Transformers 가져오기 파이프라인에서

데이터 세트에서 import load_dataset

gen_pipeline = 파이프라인(모델='hf-internal-testing/tiny-random-wav2vec2', 장치=0)

loaddataset = load_dataset('hf-internal-testing/librispeech_asr_dummy', 'clean', Split='validation[:10]')for gen_pipeline(KeyDataset(loaddataset, 'audio')) 출력:

print('지금 출력을 인쇄합니다')

인쇄('----------------')

인쇄(출력)

위 코드의 출력은 다음과 같습니다.

이것이 이 가이드의 전부입니다. 링크는 구글 주식회사 이 글에도 언급되어 있어요

결론

데이터세트에 파이프라인을 적용하려면 파이프라인() 함수를 사용하여 데이터세트를 반복하거나 ' 데이터 세트 ' 도서관. Hugging Face는 요구 사항에 따라 사용할 수 있는 데이터 세트와 모델 모두에 대해 사용자에게 GitHub 저장소 링크를 제공합니다. 이 문서에서는 Transformers의 데이터세트에 파이프라인을 적용하는 방법에 대한 포괄적인 가이드를 제공했습니다.